Amerikában súlyosabb büntetést kaphat, akiről egy algoritmus azt állítja, hogy újra bűnözni fog

- Lassan mindenki tudja, hogy a robotok elveszik a munkát.

- Azt viszont kevesebben, hogy a robotok elvehetik a szabadságunkat is.

- Legalábbis segítenek benne, ha hagyjuk – márpedig hagyjuk.

A 2002-es Különvélemény című filmben (sőt, már az alapjául szolgáló 1956-os Philip K. Dick-novellában) egy olyan jövőt mutatnak be, amiben a rendőrök már azelőtt el tudják kapni a bűnözőket, hogy azok elkövethetnék a bűnt. Ott tartályban lebegő mutánsok és a hipermodern technológia segít eldönteni, ki az, aki csak gondolatban is előkészített már egy gyilkosságot.

A valóságban ehhez elég néhány számítógép, és már majdnem ugyanott tartunk.

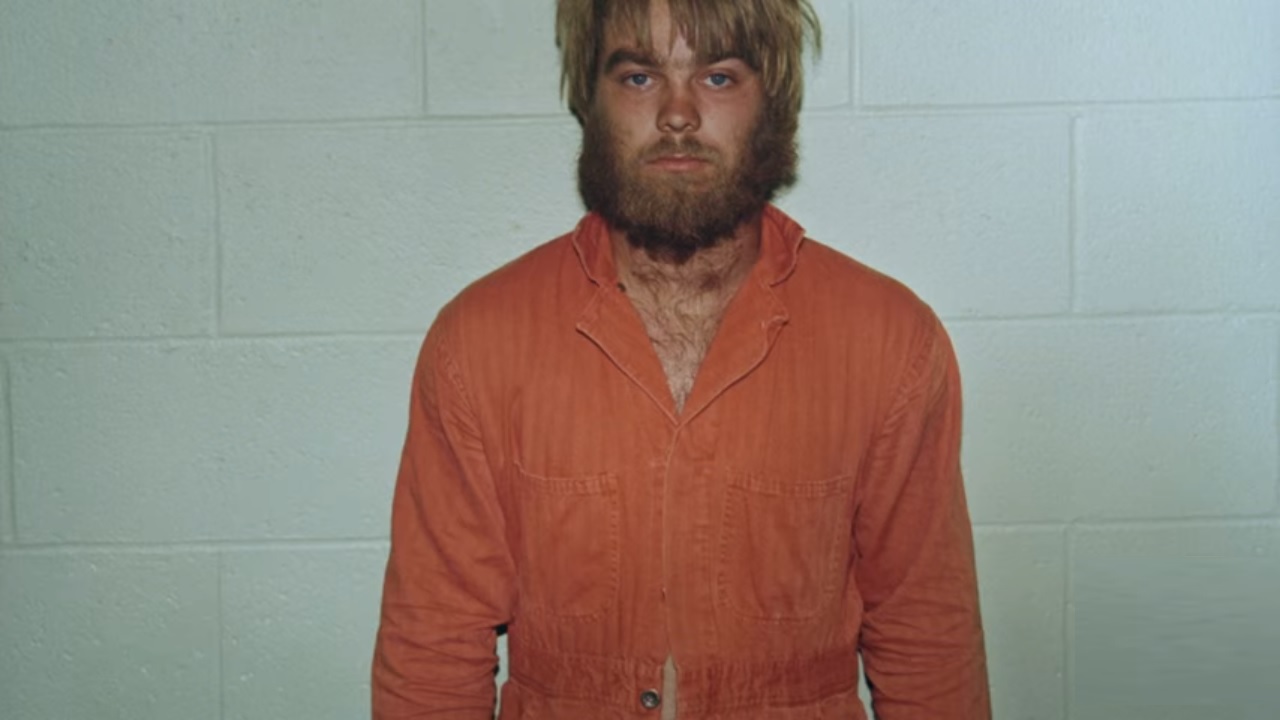

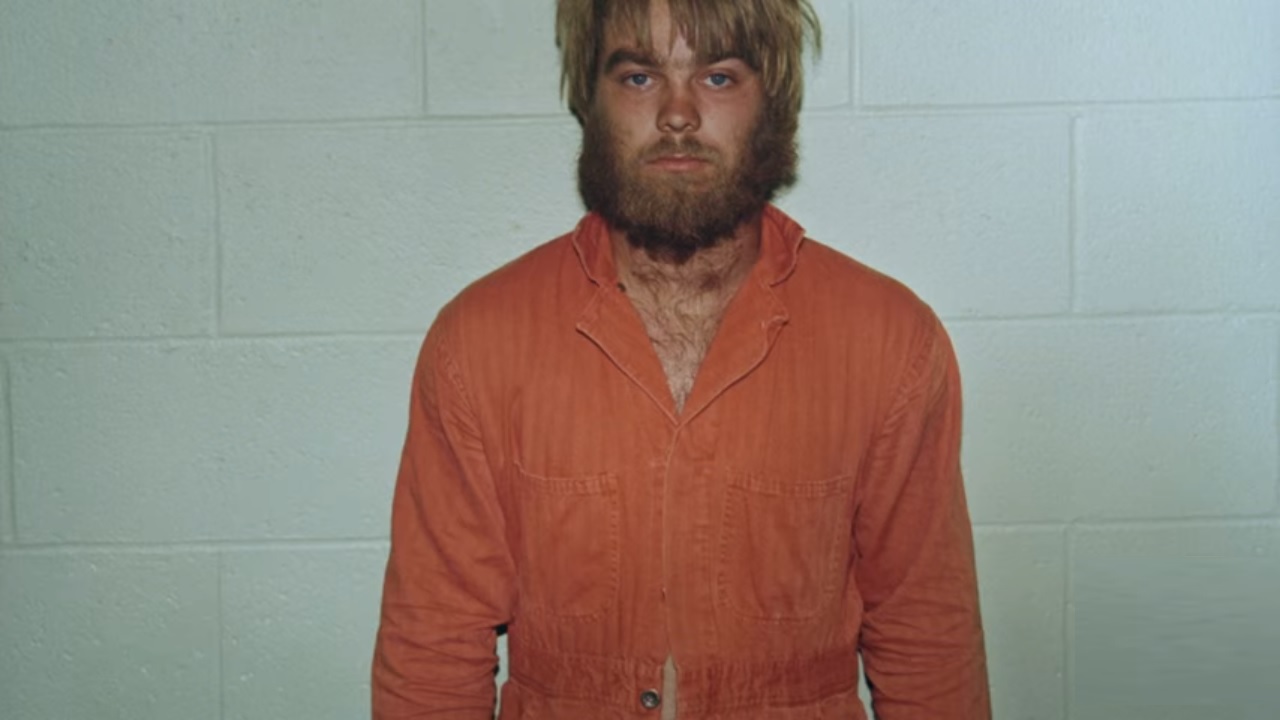

Amerika-szerte használnak a bírók és a különböző joghatóságok olyan szoftvereket, amiknek az algoritmusai előrejelzik, hogy az emberek milyen valószínűség szerint fognak a jövőben bűncselekményt elkövetni. Az embereknek egy algoritmus különböző adatpontok alapján ad egy „kockázati pontszámot”. Ha ez a pontszám nagy, az azt jelenti, hogy fennáll a bűnelkövetés valószínűsége. Ezeket figyelembe véve, sokszor ezek alapján a bíróságok szigorúbb vagy enyhébb ítélet szabhatnak ki.

De ezek az ún. kockázatértékelési szoftverek szabadalmazottak, a forráskódjuk üzleti titoknak minősül, így azt nem lehet megismerni.

Tehát a vádlottak meg se tudhatják, mi alapján kaptak magas vagy alacsony pontszámot.

A ProPublica még májusban közölte az algoritmusok utáni nyomozása eredményét, és kiderült, hogy az algoritmusok etnikailag elfogultak. Floridában a Northpointe szoftvere, a COMPAS téves számítások alapján a feketéknek hajlamosabb volt magasabb, míg a fehéreknek inkább alacsonyabb pontszámot adni hasonló alapadatokra. Az is aggályos lehet, ha nem naprakész adatokkal dolgoznak az algoritmusok, mert 5 vagy 10 évvel korábbi értékek alapján torzulhatnak a pontszámok is.

Emiatt egy Eric Loomis nevű büntetett előéletű férfi, akinek egy autólopás ügyében tartott wisconsini tárgyalásán használták a COMPAS-t, a Wisconsini Legfelsőbb Bírósághoz fordult, mert úgy érezte, a szoftver sérti a tisztességes eljáráshoz való alkotmányos jogát.

A legfelsőbb bíróság július végén elutasította az új tárgyalás iránti kérelemét, és kimondta, hogy a bíróság, ami a bűnelkövetés valószínűsége miatt 6 év börtönre ítélte, nem sértette meg a tisztességes eljáráshoz való jogát a szoftver figyelembe vételével. Ezt azzal indokolták, hogy a bíróság az ítélethirdetéskor nem kizárólag a kockázatértékelési szoftverre támaszkodott. De kérdés, hogy honnan lehet tudni, hogy egy bíró épp csak figyelembe vesz egy pontszámot, vagy támaszkodik is arra.

Az indoklás egyébként figyelembe se veszi, hogy ezek az algoritmusok eredetileg nem azért készültek, hogy bíróságok ítélethirdetésre használják: amikor az elsőt 1989-ben kipróbálták, az egész a büntetés-végrehajtási és javítóintézeteknek készült, hogy tudják, kire kell a legjobban odafigyelni, például amikor feltételesen szabadlábra helyezik.

Nem arra szánták, hogy a kapott pontszámok alapján döntsék el, hogy egy vádlottnak hány év börtönt kellene adni.

Ehhez képest Wisconsinban a COMPAS-t széles körben használják, az ítélethirdetéstől a szabadon bocsátásig minden szinten figyelembe veszik az adatait. A Wisconsini Legfelsőbb Bíróságot nem érdekli, hogy a szoftver működése üzleti titoknak minősül, nekik az a releváns, hogy milyen adatokból számol (például hogy hányszor volt korábban büntetve, milyen bűncselekményekkel kapták el, próbaidő alatt elkövetett-e valamit, vagy hogy hogyan értékelték ki korábban).

Több bíró is felszólalt amellett, hogy a kollégák ítélethozatalkor ne támaszkodjanak ezekre a szoftverekre, mert – ahogy abban semmi új nincs – a bírók többsége egyszerűen nem ért eleget a számítástechnikához, fogalmuk sincs arról, hogy működik az értékelőrendszer, és még a programokat gyártó cégektől sem kapnak elég segítséget.

Ráadásul kérdés, hogy nem mond-e ellent a wisconsini ítéletnek az a 2009-es minnesotai ítélet, ami nyilvánosságra kellett hozni egy alkoholszondát kezelő szoftver forráskódját. (Fusion, Wired)

Kommentek

Közösségünk messze túlnyomó többségének jószándéka és minden moderációs igyekezetünk ellenére cikkeink alatt időről-időre a kollégáinkat durván sértő, bántó megjegyzések jelentek meg.

Hosszas mérlegelés és a lehetőségeink alapos vizsgálata után úgy döntöttünk, hogy a jövőben a közösségépítés más útjait támogatjuk, és a cikkek alatti kommentelés lehetőségét megszüntetjük. Közösség és Belső kör csomaggal rendelkező előfizetőinket továbbra is várjuk zárt Facebook csoportunkba, a Közértbe, ahol hozzászólhatnak a cikkeinkhez, és kérdezhetnek a szerzőinktől is.